W internecie mamy do czynienia obecnie z walką dwóch modeli, ChataGPT i DeepSeeka. Kto zwycięży? Ci, którzy wiedzą kiedy kupować akcje… ale dzisiaj nie nie o tym, a o tym jak odpalić sobie lokalnie model DeepSeek R1 lokalnie, bez nadzoru wielkiego chińskiego brata.

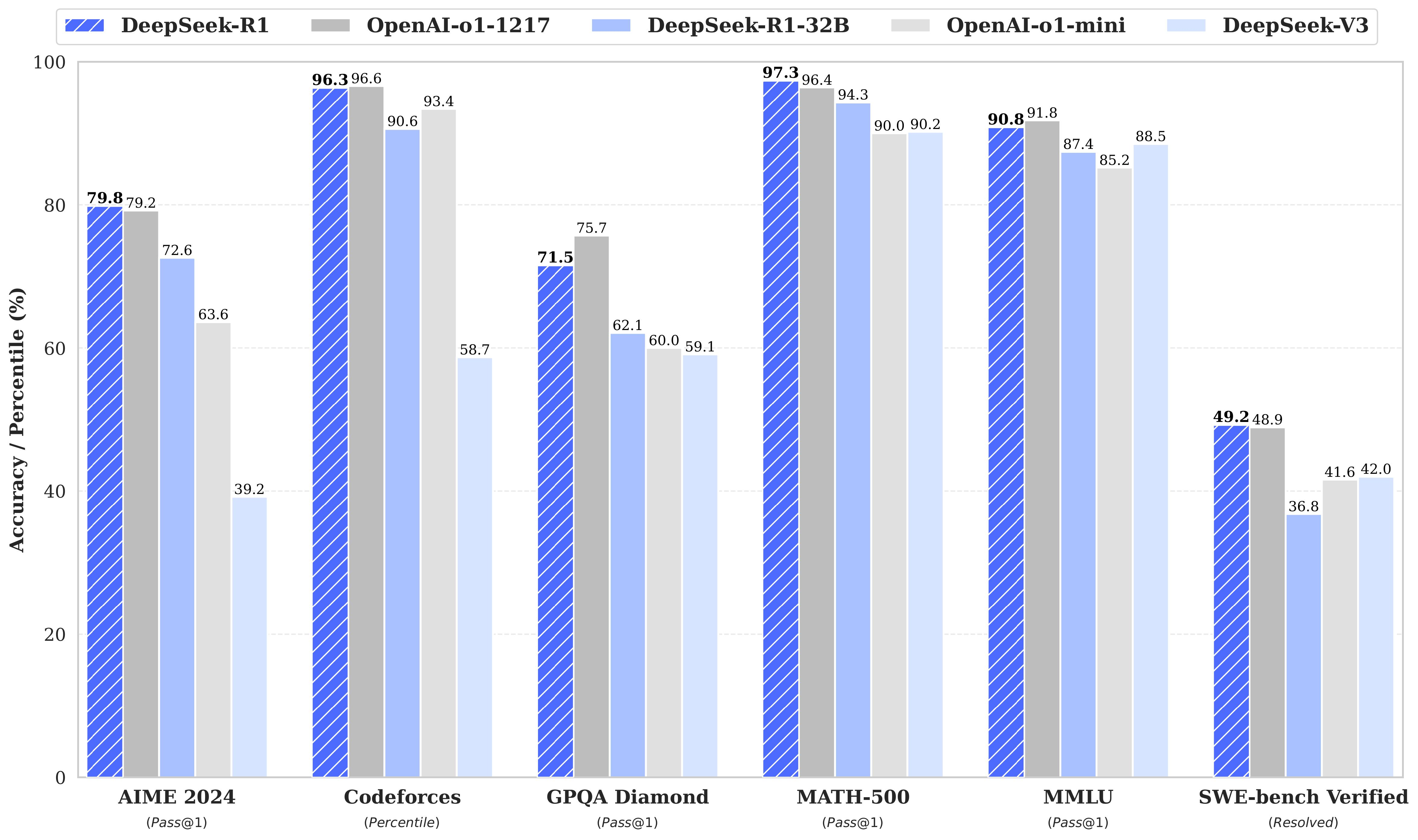

DeepSeek R1 to model, który niedawno pokonał flagowy model OpenAI (o1) w kilku testach. Jeśli zależy Ci na pełnej kontroli nad danymi, bezpieczeństwie i wydajności, warto uruchamiać modele lokalnie. Oto, jak to zrobić z pomocą narzędzia Ollama.

Dlaczego Ollama?

Ollama umożliwia uruchamianie modeli AI bezpośrednio na Twoim komputerze. Działa na macOS, Windows i Linux, zapewniając:

- Łatwą instalację – szybki setup na różnych platformach.

- Lokalne działanie – pełna prywatność Twoich danych.

- Proste przełączanie modeli – pobieraj i zmieniaj modele według potrzeb.

Jak zacząć?

- Instalacja Ollama

Wejdź na stronię Ollama:

https://github.com/ollama/ollama?tab=readme-ov-file

Zainstaluj wydanie na system który Cię interesuje i ruszamy dalej. - Pobranie DeepSeek R1

Aby pobrać główną (dużą) wersję modelu, wpisz:ollama pull deepseek-r1

Jeśli wolisz lżejszą wersję (np. 1.5B), użyj:

ollama pull deepseek-r1:1.5b

- Uruchomienie serwera

W osobnym oknie terminala wpisz:ollama serve

- Uruchomienie modelu

Aby rozpocząć pracę, wpisz:ollama run deepseek-r1

Dla wersji 1.5B:

ollama run deepseek-r1:1.5b

Lub zadaj pytanie bezpośrednio:

ollama run deepseek-r1:1.5b "Czy ktoś potrafi w końcu w komunizm?"

Co potrafi model DeepSeek R1?

Naturalne rozmowy – prowadzenie dialogów na poziomie ludzkim.

Naturalne rozmowy – prowadzenie dialogów na poziomie ludzkim.- Wsparcie przy kodowaniu – generowanie oraz optymalizacja kodu.

- Rozwiązywanie problemów – od matematyki po algorytmy.

Uruchamianie modelu lokalnie gwarantuje szybsze odpowiedzi i pełną kontrolę nad danymi, bez wysyłania ich na zewnętrzne serwery.

Wersje „distilled”

Mniejsze warianty DeepSeek R1 (np. 1.5B, 7B) są zoptymalizowane przez tzw. distillation – proces, w którym mniejszy model uczy się na podstawie wzorców dużego modelu. To idealne rozwiązanie, gdy masz ograniczone zasoby lub potrzebujesz szybkich odpowiedzi.

Mniejsze warianty DeepSeek R1 (np. 1.5B, 7B) są zoptymalizowane przez tzw. distillation – proces, w którym mniejszy model uczy się na podstawie wzorców dużego modelu. To idealne rozwiązanie, gdy masz ograniczone zasoby lub potrzebujesz szybkich odpowiedzi.

Jedna wskazówka!

- Automatyzacja: Wykorzystaj skrypty bash do automatyzacji poleceń, na przykład:

#!/usr/bin/env bash

PROMPT="$*"

ollama run deepseek-r1:7b "$PROMPT"

- Integracja z IDE: Wiele edytorów pozwala na konfigurację zewnętrznych narzędzi, co umożliwia generowanie lub refaktoryzację kodu bezpośrednio z poziomu IDE.

I pamiętaj – nie pytaj o Xi Jinpinga! 😉

Nie no, pytaj, w końcu bawimy się lokalnie.